试看链接https://pan.baidu.com/s/1tMqzW5AxDvTMZQMtnk9Hhg?pwd=22ea

相关推荐

基于大模型LLM的开发与编程教程

LLM算法工程师全能实战营(完结)

慕K网体系课-LLM应用开发平台特训营(完结)

LLM大语言模型算法特训,带你转型AI大语言模型算法工程师(完结)

课程介绍

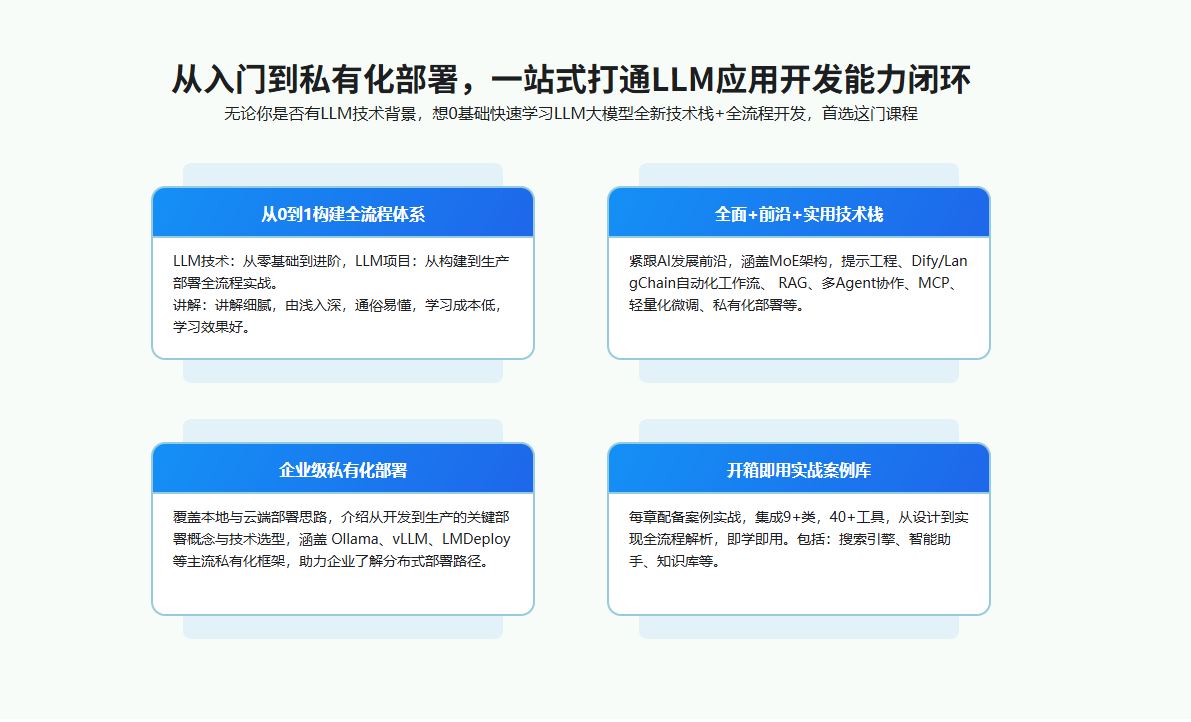

本课汇聚一线AI架构师与工程专家智慧,聚焦企业LLM应用开发、私有化部署及性能优化痛点。带你从LLM零基础开始,讲解MoE架构,实践Ollama/vLLM等私有化部署方案,精通企业级提示工程、Dify/LangChain自动化工作流、RAG、MCP调用、轻量化微调及多Agent协作等技术。通过从0到1构建AI编程助手、智能客服等全流程项目实战,具备大模型和业务需求整合能力,一站式打通LLM应用开发能力闭环

资源目录

-

第1章 【扬帆启程】深度求索:课程导学与AI基础 试看3 节 | 20分钟

- 视频:1-1 课程导学与安排【全面了解课程】 (19:49)试看

- 图文:1-2 大模型学习避坑指南:AI术语、多模态等

- 图文:1-3 学习路线:没有Python项目经验怎么学习?

-

第2章 【行业概览】 LLM时代背景与应用价值,搜索+生成的时代7 节 | 96分钟

- 视频:2-1 什么是大语言模型? (11:04)

- 视频:2-2 大模型的应用?如何用好?找准方向 (12:53)

- 视频:2-3 GPT系列与模型演进 (16:59)

- 视频:2-4 LLM与传统NLP对比 (14:10)

- 视频:2-5 大规模语料与训练挑战 (12:35)

- 视频:2-6 [更新]大模型行业应用案例(MCP、Manus、Sora、v0) (17:43)试看

- 视频:2-7 大模型现存局限 (10:07)

-

第3章 【初识DeepSeek】 多模态与MoE核心特性5 节 | 60分钟

- 视频:3-1 DeepSeek发展历程&模型核心特点 (16:10)

- 视频:3-2 模型架构:MoE等核心要点 (11:52)

- 视频:3-3 [资源推荐]大模型训练数据集与训练策略- (11:24)

- 视频:3-4 与其他开源模型的比较(重视开源协议&商用授权) (11:07)

- 视频:3-5 [资源推荐]Deepseek版本+扩展应用+生态介绍 (09:01)

-

第4章 【通用提示词能力】大模型“基石”,从聊天到精准AI交互7 节 | 97分钟

- 视频:4-1 为什么要设计提示词:AI输出准确性 (19:01)

- 视频:4-2 常见场景示例:翻译、摘要、润色 – (19:31)

- 视频:4-3 创意场景示例:文案营销、角色扮演 – (15:06)

- 视频:4-4 进阶场景示例:代码生成、逻辑推理 (12:21)

- 视频:4-5 问题调试:如何改进不理想的输出 (11:06)

- 视频:4-6 组合提示词:从简短到复杂的演练 (14:33)

- 视频:4-7 [资源]提示词万词聚合网站 (04:34)

-

第5章 【进阶应用】界面化工作流整合:让DeepSeek融入业务5 节 | 63分钟

- 视频:5-1 AI工作流概念:自动化与协同 (11:05)

- 视频:5-2 国内外常见工作流工具概览(Coze&Dify&Zapier) (11:48)

- 视频:5-3 Dify+Ollama本地部署实战(Docker部署) (13:42)

- 视频:5-4 工作流示例(一):Dify+Deepseek实现网文摘要工作流 (11:49)

- 视频:5-5 工作流示例(二):智能客服-调用知识库 (13:42)

-

第6章 【企业级开发准备】 AI编程环境与常用开发工具LLM应用案例11 节 | 120分钟

- 视频:6-1 AI必备编辑器:Cursor&windsurf&trae (13:12)

- 视频:6-2 AI必备编程插件推荐Roo&Cline&WindSurf (13:53)

- 视频:6-3 在Cursor&AI插件中集成Deepseek大模型 (07:28)

- 视频:6-4 桌面端工具:LMStudio&GPT4all&Cherry&ChatWise (13:01)

- 视频:6-5 [重要]离线环境下,是否可以使用AI编程?Ollama配置揭秘 (14:08)

- 视频:6-6 案例1:如何自动编程?巧用Agents功能(工具案例) (13:29)

- 视频:6-7 Cursor账号白嫖方式&重置机器码脚本 (04:42)

- 视频:6-8 案例2:长文写作技巧(角色植入、背景植入、写作手法植入) (09:10)

- 视频:6-9 案例3:RAG初体验-长文档会话工具(智能助手) (05:57)

- 视频:6-10 案例4:使用CherryStudio+ollama配置本地知识库 (06:21)

- 视频:6-11 案例5:搭建智能助手:本地Dify知识库+Ollama本地模型 (18:38)

-

第7章 【RAG根基】 深度学习与Transformer剖析5 节 | 34分钟

- 视频:7-1 Transformer 架构概览:原理演变与必备学习资源 (05:48)

- 视频:7-2 从 Token 看概率:大模型如何理解语言与传统 NLP 区别 (06:05)

- 视频:7-3 什么是 Embedding:文本到向量的转换原理 (05:03)

- 视频:7-4 Transformer 自注意力机制解析 (07:17)

- 视频:7-5 自注意力可视化、Embedding检索与微调生成 (09:20)

-

第8章 【本地私有化】 DeepSeek部署与数据安全9 节 | 98分钟

- 视频:8-1 [重要]模型硬件推荐与系统环境要求1111 (13:27)

- 视频:8-2 [生产级]流行的模型推理框架vLLM&LMDeploy&ktransformers (10:28)

- 视频:8-3 [扩展]大模型国产化:硬件GPU服务商选择 (07:01)

- 视频:8-4 GPU算力服务器租用方案(AutoDL&智星云&恒源云) (16:13)

- 视频:8-5 [AI脚本]Linux环境离线安装Ollama (14:27)

- 视频:8-6 [扩展]AutoDL外部数据上传方案(七牛云对接) (06:16)

- 视频:8-7 AutoDL+Ollama:大模型私有化部署实战(配合客户端演示) (07:19)

- 视频:8-8 Ollama 高阶实战:环境变量、模型路径与并发解析 (08:59)

- 视频:8-9 别让模型裸奔!教你给 Ollama 加上 Token 安全锁 (13:02)

-

第9章 【API实践】DeepSeek推理与多场景接入9 节 | 105分钟

- 视频:9-1 AI开发环境准备:vscode插件+conda+pip国内加速源 (10:04)

- 视频:9-2 模型调用入门:接口、参数、费用全解锁 (12:46)

- 视频:9-3 多轮对话实战:用 Python 模拟 ChatGPT 式会话流程 (08:26)

- 视频:9-4 模型响应提速关键:搞懂流式输出与实时解析 (08:01)

- 视频:9-5 模型参数全掌握:温度、Top P、Token 配置与场景实战 (13:24)

- 视频:9-6 聊天机器人实战:多轮会话、上下文管理与流式输出实战 (22:38)

- 视频:9-7 [代码生成]RooCode实战:提示词驱动开发与调试实战 (10:06)

- 视频:9-8 模型函数调用原理(对比MCP) (11:10)

- 视频:9-9 复杂函数调用实战:AI 生成 + VS Code 调试全流程解析 (07:48)

-

第10章 【爆火AI工具】MCP 能力开发与接入实战全流程(纯扩展的)9 节 | 81分钟

- 视频:10-1 理解 MCP:下一代模型能力调用平台与 Function Call 的对比实战 (11:02)

- 视频:10-2 MCP 安装与服务选择指南+环境配置- (12:41)

- 视频:10-3 常见问题:MCP加载失败如何解决? (09:49)

- 视频:10-4 常见问题:使用uv&pip来安装MCP服务 (04:56)

- 视频:10-5 高质量 MCP 服务推荐:去哪里找、怎么选、哪些值得用 (08:39)

- 视频:10-6 开发你的第一个 MCP 服务:协议理解、需求分析与入门实践 (07:46)

- 视频:10-7 MCP开发环境搭建:mcp-starter初始化与调试实操 (08:39)

- 视频:10-8 [AI协作开发]从提示词到可用 IP 查询接口的全流程实践 (11:38)

- 视频:10-9 集成与发布:让你的 MCP 服务在 IDE 和 AI 插件中可用 (04:56)

-

第11章 【搜索整合】 RAG原理与本地搜索方案6 节 | 73分钟

- 视频:11-1 搜索增强入门:为什么大模型必须借助搜索?完整流程与原理解析 (10:36)

- 视频:11-2 搜索服务推荐:Google、Bing、SerpAPI、百度全解析 (07:49)

- 视频:11-3 实战 Google Custom Search:账号申请、API Key 管理与搜索接口开发 (14:05)

- 视频:11-4 实战百度千帆搜索:接口开发、价格对比与搜索模式解析 (13:00)

- 视频:11-5 搜索×工具×会话融合案例预览:构建智能聊天机器人的完整流程 (04:58)

- 视频:11-6 实战打造智能聊天机器人:融合搜索、工具调用与多轮对话 (21:44)

-

第12章 【本地化搜索方案】开源库与数据整合7 节 | 76分钟

- 视频:12-1 [章导学]本地搜索介绍:本地检索、爬虫采集、元搜索 (05:51)

- 视频:12-2 爬虫搜索演示:抓取百度&谷歌内容+解析搜索结果 (04:47)

- 视频:12-3 本地搜索实现:轻量级爬虫开发+核心代码逻辑讲解 (20:36)

- 视频:12-4 本地搜索调试:理解爬虫流程与搜索原理(扩展介绍crawl4ai) (09:25)

- 视频:12-5 [技术视野]元搜索与文档搜索引擎的对比 (06:08)

- 视频:12-6 [进阶]元搜索方案SearxNG:容器化部署与接口调试 (14:56)

- 视频:12-7 Elasticsearch本地化运行全流程实战 (14:15)

-

第13章 【向量检索】解锁海量数据的高效检索之道6 节 | 41分钟

- 视频:13-1 [章导学]RAG 核心技术概览 (06:27)

- 视频:13-2 [基础]向量&向量空间概念解析 (05:19)

- 视频:13-3 嵌入模型选型指南:基于 MTEB 榜单与场景需求筛选 (05:34)

- 视频:13-4 从训练到检索:嵌入模型向量生成与相似度匹配原理 (09:51)

- 视频:13-5 向量数据库选型指南:功能对比与场景落地 (02:54)

- 视频:13-6 Chroma 实战:本地部署、数据写入与向量查询 (10:38)

-

第14章 【编排实战】运用LangChain串联搜索与生成,打造智能工作流6 节 | 54分钟

- 视频:14-1 LangChain入门全览:核心模块解析与环境准备 (12:58)

- 视频:14-2 大模型模块:基础对话与流式响应输出 (05:07)

- 视频:14-3 Prompt实践:构建结构化提示词并动态注入变量 (07:24)

- 视频:14-4 Memory实战:构建有上下文记忆的对话系统 (13:54)

- 视频:14-5 Tools:让模型拥有可调用的扩展能力 (05:54)

- 视频:14-6 Agent实践:结合Prompt与Tools实现复杂决策调用 (07:49)

-

第15章 【RAG进阶】搜索与向量数据库的深度结合6 节 | 64分钟

- 视频:15-1 LangChain搜索工具实战:集成DuckDuckGo实现实时信息查询 (07:16)

- 视频:15-2 [AI赋能]Langchain本地搜索:SearxNG+Agent实战 (11:16)

- 视频:15-3 RAG数据工程起点:文档加载与结构化准备 (08:36)

- 视频:15-4 RAG 数据工程核心:文本切分 (07:16)

- 视频:15-5 RAG向量数据库实战:初始化+写入与查询全流程 (14:11)

- 视频:15-6 RAG全流程实战:从文档到问答的闭环实现 (15:04)

-

第16章 【多Agent协同】企业级搜索分析的强化,更灵活的知识与决策14 节 | 156分钟

- 视频:16-1 智能体Agents:开发案例&执行流程揭秘 (14:17)

- 视频:16-2 定制化agents:通过Prompt引导执行流程 (09:07)

- 视频:16-3 多Agent协作实战:打造智能待办机器人 (18:15)

- 视频:16-4 【进阶】案例演示:高仿ChatGPT深度研究 (07:33)

- 视频:16-5 【进阶】深入研究agent实现(搜索+分析+报告) (10:50)

- 视频:16-6 n8n工作流技术方案介绍+资源推荐 (08:39)

- 视频:16-7 n8n本地化docker部署+配置实战(镜像加速+激活许可) (10:24)

- 视频:16-8 技术学习方法论:AI辅助思考与实践反思 (10:52)

- 视频:16-9 n8n自动化实战:HackerNews收集、AI 处理与日报邮件发送 (16:46)

- 视频:16-10 智能日报流程优化(日期+邮件主题定制) (07:47)

- 视频:16-11 n8n子流程封装与测试:打造高复用自动化模块 (12:15)

- 视频:16-12 [进阶]LLM 自主工具路由:多 Agent 子流程智能调度实战 (13:43)

- 视频:16-13 [扩展]网页爬取方案:crawl4ai与社区节点解析 (09:43)

- 视频:16-14 [更新]MCP Stdio模式:配置 HackerNews MCP服务 (05:22)

-

第17章 【可视化UI进阶】开源UI界面Open WebUI打造本地 AI 聊天系统7 节 | 64分钟

- 视频:17-1 Open WebUI 安装与初体验:配合 Ollama 本地跑通模型 (10:21)

- 视频:17-2 OpenWebUI实现多Agent对话功能 (04:28)

- 视频:17-3 本地知识库实战:构建智能客服助手 (03:41)

- 视频:17-4 联网搜索配置:接入SearxNG&DuckDuckGo (05:29)

- 视频:17-5 OpenWebUI三类函数功能解析 (11:17)

- 视频:17-6 OpenWebUI容器化Docker部署+ Pipeline实战 (11:06)

- 视频:17-7 开源聊天前端概览:NextChatWeb 与 LobeChat 快速对比入门 (17:33)

-

第18章 【生产部署】高性能推理与容器化思路3 节 | 40分钟

- 视频:18-1 为什么Ollama、LM Studio不适合生产场景 (18:03)

- 视频:18-2 高性能推理框架对比:vLLM、LMDeploy (11:09)

- 视频:18-3 分布式与量化:大模型高效推理的关键 (10:41)

-

第19章 【定制简易界面】 开发测试用:Gradio/Streamlit打造交互体验9 节 | 69分钟

- 视频:19-1 Gradio 快速原型:构建 LLM 页面并自动生成中文文档 (11:01)

- 视频:19-2 Gradio 页面快速调试:热重载与重启实战 (05:39)

- 视频:19-3 Gradio DeepSeek集成实战 (08:16)

- 视频:19-4 Gradio接入Ollama本地模型流程与会话 (09:07)

- 视频:19-5 Gradio本地模型对接与会话 (07:19)

- 视频:19-6 Streamlit快速上手:安装+功能与Gradio 对比 (06:11)

- 视频:19-7 Streamlit组件入门:侧边栏、控件、表格与可视化 (04:47)

- 视频:19-8 Streamlit对接DeepSeek:大模型流式输出实战 (08:56)

- 视频:19-9 Streamlit对接Ollama:本地模型加载与会话 (07:04)

-

第20章 【接口并发】 API安全、限流与监控管理,如何效率+性能兼顾5 节 | 66分钟

- 视频:20-1 并发与限流方案对比:AI 咨询落地实战 (19:53)

- 视频:20-2 One API 集成实战:LLM 调用网关与分发方案 (21:56)

- 视频:20-3 LLM底层API开发核心技术方案对比(Python&Node.js) (06:32)

- 视频:20-4 API网关与负载均衡:基础实现思路 (08:08)

- 视频:20-5 全链路监控与日志选型(主流方案对比) (08:46)

-

第21章 【微调与扩展】 让模型更贴近业务需求3 节 | 56分钟

- 视频:21-1 微调入门:为什么要微调?主流方法与差异解析 (13:45)

- 视频:21-2 Unsloth 微调实战:Colab 环境配置与代码详解 (20:44)

- 视频:21-3 LlamaFactory:界面化微调全流程指南 (20:51)

-

第22章 【课程回响】AI生成式课程笔记 × 教学内容RAG化实践11 节 | 158分钟

- 视频:22-1 课程视频RAG项目概览:背景梳理与需求规划 (05:30)

- 视频:22-2 本地视频转文字实战:Whisper模型部署与使用 (14:56)

- 视频:22-3 通义听悟API集成实战:Cookie获取、音频上传与任务状态监控 (24:52)

- 视频:22-4 封装工具Service:下载音频转写结果 (14:41)

- 视频:22-5 批处理逻辑:对接待处理音频并创建测试逻辑 (17:32)

- 视频:22-6 多格式下载优化:支持SRT&DOCX等文件类型并测试 (10:28)

- 视频:22-7 n8n工作流实战:自动生成课程章节笔记与多Agent协作 (18:31)

- 视频:22-8 n8n流程优化:高级提示词、输出命名与批量执行指南 (15:26)

- 视频:22-9 n8n工作流:本地向量嵌入+Milvus部署 (14:02)

- 视频:22-10 课程笔记助手:Milvus向量检索+Chat回答+格式化输出 (11:30)

- 视频:22-11 课程助手:对外MCP服务配置指南 (10:25)

声明:本站所有资料均来源于网络以及用户发布,如对资源有争议请联系微信客服我们可以安排下架!